Голосовые помощники, такие как Алиса от Яндекса, становятся инструментом в руках злоумышленников из-за особенностей их функционирования и доверия пользователей.

Содержание

Способы эксплуатации технологий в преступных целях

Основные способы использования Алисы преступниками

Социальная инженерия

- Имитация голоса доверенных лиц

- Фишинговые сценарии через голосовые команды

- Манипуляции с психологией доверия к технологиям

Технические уязвимости

- Эксплуатация ошибок в системах распознавания голоса

- Использование уязвимостей API интеграций

- Злоупотребление функциями автоматизации

Сокрытие преступной деятельности

- Шифрование коммуникаций через голосовые команды

- Создание цифровых алиби

- Автоматизация мошеннических схем

Примеры преступных схем с использованием Алисы

| Тип мошенничества | Механизм действия | Способы защиты |

| Финансовые махинации | Голосовые команды для переводов | Двухфакторная аутентификация |

| Кража данных | Поддельные навыки Алисы | Проверка источников навыков |

| Взлом умного дома | Голосовые команды устройствам | Отключение голосового управления |

Как защититься от злоупотреблений

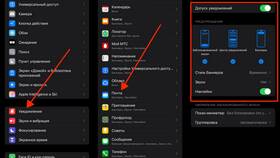

- Ограничить доступ к конфиденциальным функциям

- Отключить голосовые платежи

- Регулярно обновлять ПО голосового помощника

- Проверять историю голосовых команд

- Использовать сложные коды доступа

Юридические аспекты

- Ответственность за создание вредоносных навыков

- Правовое регулирование голосовых технологий

- Сложности расследования цифровых преступлений

Перспективы развития защиты

Разработчики внедряют биометрическую верификацию голоса, поведенческий анализ и системы обнаружения аномалий для противодействия криминальному использованию голосовых помощников.